ANTICHAT — форум по информационной безопасности, OSINT и технологиям

ANTICHAT — русскоязычное сообщество по безопасности, OSINT и программированию.

Форум ранее работал на доменах antichat.ru, antichat.com и antichat.club,

и теперь снова доступен на новом адресе —

forum.antichat.xyz.

Форум восстановлен и продолжает развитие: доступны архивные темы, добавляются новые обсуждения и материалы.

⚠️ Старые аккаунты восстановить невозможно — необходимо зарегистрироваться заново.

|

|

15.11.2008, 22:40

|

|

Banned

Регистрация: 06.10.2006

Сообщений: 288

Провел на форуме:

2741921

Репутация:

469

|

|

Кста вот ещё вспомнил про Breve http://www.spiderland.org/

Вообщем типо симулятор искусственного интеллекта.

|

|

|

ТЕСТ ТЬЮРИНГА. ПРИЗ ЛЕБНЕРА. |

19.11.2008, 21:46

|

|

Постоянный

Регистрация: 01.09.2007

Сообщений: 866

Провел на форуме:

2022674

Репутация:

1224

|

|

ТЕСТ ТЬЮРИНГА. ПРИЗ ЛЕБНЕРА.

ТЕСТ ТЬЮРИНГА. ПРИЗ ЛЕБНЕРА.

ТЕСТ ТЬЮРИНГА.

Начало эры искусственного интеллекта приходится на середину прошлого века, когда Алан Тьюринг в своей работе "Может ли машина мыслить?" (оригинальное название - Computing Machinery and Intelligence) сформулировал критерий интеллектуальности, который до сих пор остается основным определением этого понятия.

На самом деле любая попытка сформулировать четкое определение понятия "интеллект" обречена, потому что нам не известна природа интеллектуальности. Если задаться простым вопросом о том, является ли кошка интеллектуальным существом, то и здесь ответы будут неоднозначными. Единственное действительно интеллектуальное существо, в котором нельзя сомневаться - это человек. Поэтому Тьюринг предложил для определения интеллектуальности компьютерной системы проводить сравнение этой системы с заведомо интеллектуальным существом - человеком.

Однако всем ясно, что нельзя строить сравнение интеллектуальности человека и ЭВМ на основе какого-то стандартного набора тестов наподобие IQ, так как не составит проблем написать компьютерную программу, которая знала бы ответы и принципы решения конечного числа известных задач. Поэтому сравнить способности ЭВМ со способностями человека сможет только другое заведомо интеллектуальное существо - человек-наблюдатель.

Тест Тьюринга проводится в виде эксперимента следующим образом: в разные комнаты помещаются компьютерная система, претендующая на интеллектуальность и подлежащая тестированию, и человек-испытуемый. В третьей комнате находится человек-наблюдатель, который может общаться с двумя испытуемыми с помощью текстовых сообщений (с помощью IRC или ICQ). Задача наблюдателя состоит в том, чтобы в ходе беседы обнаружить, в какой комнате находится человек, а в какой - компьютерная система. Система признается интеллектуальной, если в результате серии экспериментов наблюдателю (или нескольким наблюдателям) удается однозначно отличить компьютерную систему от человека.

ПРИЗ ЛЕБНЕРА.

В 1990 году был учрежден приз Лебнера: проводятся ежегодные соревнования на прохождение теста Тьюринга, выдается приз размером в $2 тыс. за самую удачную (по мнению жюри) программу и $25 тыс. за программу, которая ввела бы жюри в заблуждение. Дополнительный приз в $100 тыс. обещан программе, которая пройдет полный аудиовизуальный тест Тьюринга, но эксперты скептично относятся к вероятности того, что в ближайшее время этот приз кто-то получит. До сих пор вручались лишь бронзовые медали, они же поощрительные призы, программам, которые продемонстрировали лучшие результаты в беседе с членам жюри. |

|

|

19.11.2008, 21:48

|

|

Постоянный

Регистрация: 01.09.2007

Сообщений: 866

Провел на форуме:

2022674

Репутация:

1224

|

|

Если кому интересна эта тема и кому есть что сказать-просьба тоже выкладывать интересный материал или ссылки на книги и тп

|

|

|

19.11.2008, 22:03

|

|

Постоянный

Регистрация: 01.09.2007

Сообщений: 866

Провел на форуме:

2022674

Репутация:

1224

|

|

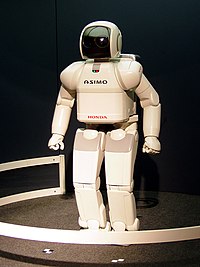

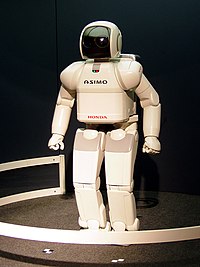

Роботы.

Роботы.

Роботы.

Другой круг вопросов, связанных с ИИ - робототехника, достижения которой уже давно используются на предприятиях, а недавно начали проникать и в повседневную жизнь.

Робот (от чешск. robota) — Автоматическое устройство с антропоморфным действием, которое частично или полностью заменяет человека при выполнении работ в опасных для жизни условиях или при относительной недоступности объекта.

История возникновения слова.

Слово «робот» было придумано чешским писателем Карелом Чапеком и его братом Йозефом и впервые использовано в пьесе Чапека «Р.У.Р.» («Россумские универсальные роботы», 1921). До появления промышленных роботов считалось, что роботы должны выглядеть подобно людям.

Надо сказать, что роботы Чапека были не механическими, а биологическими существами. Просто у них отсутствовали некоторые человеческие функции, в частности -- способность влюбляться, а значит -- и желание продолжать свой род. В произведении фантаста роботы преодолели этот недостаток и стали неотличимы от людей.

Интересные факты.

В 1981 году Кензи Урада, рабочий завода Kawasaki стал первой официальной жертвой, погибшей от руки робота. С этого времени число жертв роботов растет, несмотря на внедрение усовершенствованных механизмов безопасности.

18 марта 2008 года 81-летний австралиец стал первым человеком, который покончил жизнь самоубийством при помощи робота, которого сам собрал согласно схемам, взятым из сети Интернет.

Повсеместные роботы.

Роботы-пылесосы - это только один пример использования робототехнических средств в быту. На самом деле понятие "робототехника" уже давно потеряло свой романтический ореол: на производстве повсеместно используются роботы, которые автоматизируют процесс изготовления и сборки продукта. И еще больше впечатляет то, что создание многих современных изделий просто невозможно без роботизированных конвейеров сборки. Например, электронные компоненты и платы могут быть настолько компактными и хрупкими, что доверить их сборку человеку чревато непоправимыми последствиями.

Промышленные роботы часто внешне имеют мало общего с человеком. Помимо промышленных роботов, за последние годы в мире народились домашние роботы, по облику похожие на человека или домашних животных. Лидером в этой области является компания Sony, выпустившая в 1999 году робота-собаку AIBO (англ. Artificial Intelligence Bоt). Сейчас в линейку AIBO входит робот-кошка AIBO ERS-7 - весьма мощный компьютер со специализированным программным обеспечением, поставляемым на картах памяти Memory Stick.

Владелец "собачки" может выбрать режим воспитания питомца, и тогда его (робота) возможности будут расти по мере жизни и в зависимости от окружения будет формироваться определенный характер. А можно поселить у себя дома уже готовое "воспитанное" существо, которое умеет реагировать на команды и выполнять полезные действия, к примеру сообщать владельцу о пришедшей электронной почте, фотографировать и сохранять в памяти или посылать по электронной почте фотографии, заменять будильник и т.д.

Следующим логическим шагом по применению ИИ должно стать создание бытовых человекоподобных роботов. Многие компании уже работают над этим и даже создали экспериментальные прототипы. Например, SONY Qrio умеет танцевать (в том числе в коллективе с такими же роботами), дирижировать оркестром, бегать на двух конечностях, вставать на ноги после падения и т.д. |

|

|

Шесть правил идеального робота |

20.11.2008, 17:19

|

|

Постоянный

Регистрация: 01.09.2007

Сообщений: 866

Провел на форуме:

2022674

Репутация:

1224

|

|

Шесть правил идеального робота

Шесть правил идеального робота

Технологический прогресс за последние десятилетия привел к появлению целого ряда «умных» машин, которые с течение времени только повышают свои «интеллектуальные» способности. Одновременно с этим происходит и расширение профессиональных навыков роботов – они учатся управлять автомобилем, помогать в уходе за пожилыми и больными, и даже осваивают целый ряд военных специальностей: разведчики, саперы, пехотинцы и пр. В связи с этим крайне необходимо интегрировать все более умелых роботов в человеческое общество, и для этого необходимо, по мнению Вендела Уолока, специалиста по этике Йельского Университета, и Колина Алена, историка и философа Университета Индианы, реализовать шесть правил, которые снизят опасность, исходящую от умнеющих роботов.

Правило первое: не доверять роботам задач, которые связаны со значительным риском для общества. Другими словами, действия роботов должны быть предсказуемыми, а возможность катастроф сведена к минимуму. Однако уже сейчас поведение вычислительных систем не всегда возможно прогнозировать, а в будущем, по мере усложнения интеллектуальных способностей роботов и компьютеров, их «самостоятельность» будет только повышаться.

Правило второе: ни при каких условиях не доверять роботам оружие, и/или не предоставлять им управление вооружением. К сожалению, предотвратить появление боевых роботов невозможно – уже разработаны и поставлены на вооружение полуавтономные роботизированные установки, в небо подняты беспилотные летательные аппараты, а несколько единиц боевых роботов были посланы в Ирак, пусть и для ознакомления с их возможностями.

Правило третье: соблюдение трех законов робототехники Азимова. Знаменитые законы Айзека Азимова должны обеспечить безопасное сосуществование роботов в человеческом обществе, избежать несчастных случаев и злоупотребления роботами своими возможностями. Однако подводным камнем является тот факт, что Азимов специализировался на научной фантастике и не имел опыта в роботостроении, а значит, его законы лишены научной базы. Более того, сам автор в своих произведениях описывает ситуации, когда сформулированные им правила перестают работать в нужном направлении.

Правило четвертое: программирование роботов с учетом целого ряда условий и принципов. Одним из таких принципов должен являться принцип максимально полезных действий – то есть, выбирать из целого ряда возможных поступков лишь те, которые принесут пользу как можно большему количеству людей. С другой стороны, следуя этому принципу робот может принести в жертву жизнь одного человека, чтобы спасти жизнь пятерых. Сегодня же ни один врач не способен за счет убийства одного человека спасти жизнь и здоровье других пациентов, реализация столь высоких моральных качеств – одна из главных проблем, которая встанет перед робототехниками в будущем.

Правило пятое: постоянное обучение роботов. Это позволит «умным» машинам гибко изменять свое поведение с течением времени, анализировать собственные действия, выбирая из них правильные и ошибочные. Впрочем, достижение указанной цели невозможно без целого ряда технологических прорывов, ведь уровень развития современной науки не позволяет создавать действительно мыслящих и анализирующих роботов.

Правило шестое: наделение роботов основным набором эмоций. Подобная «функциональность» крайне необходима для интеграции роботов в человеческое общество – машины должны с легкостью распознавать эмоции человека, на основании чего выбирать собственную стратегию поведения. Ведь не секрет, что значительная часть информации, необходимой для успешного общения человека с себе подобными, передается за счет выражения лица, языка жестов – все это должны с легкостью воспринимать и роботы. И хотя эта задача очень сложна в реализации, уже сейчас наблюдаются подвижки в создании роботов, способных распознавать эмоции. То есть, задача не является невыполнимой.

http://www.3dnews.ru/news/shest_pravil_idealnogo_robota/ |

|

|

05.02.2009, 01:16

|

|

Новичок

Регистрация: 01.02.2009

Сообщений: 2

Провел на форуме:

7073

Репутация:

0

|

|

Сообщение от m0le[x]

Вот, как и обещал, залил очень хорошие книги по теме.

Алтунин - Модели и алгоритмы принятия решений в нечётких условиях

Формат: chm

Барский - Нейронные сети - распознавание, управление, принятие решений

Формат: pdf

Батыршин - Основные операции нечёткой логики и их обобщения

Формат: pdf

Гаврилова - Базы знаний интеллектуальных систем

Формат: djvu

Гайдышев И. - Анализ и обработка данных. Специальный справочник

Формат: djvu

Головко - Нейронные сети - обучение, организация и применение

Формат: djvu

Гриняев С.Нечёткая логика в системах управления

Формат: pdf

Заенцев - Нейронные сети - основные модели

Формат: pdf

Закревский - Логика распознования

Формат: djvu

Ярушкина - Нечеткие гибридные системы

Формат:djvu

Общий размер архива: 21.9 Мб

СкачатьВыложите пожалуста книгу Головко - Нейронные сети - обучение, организация и применение

Формат: djvu

или по возможности полный архив

|

|

|

18.04.2009, 12:33

|

|

Постоянный

Регистрация: 12.01.2008

Сообщений: 336

Провел на форуме:

797429

Репутация:

598

|

|

долгое время обдумывал статью на этот вопрос, точнее ее сочинял. потом забил, а потом обнаружил похожую здесь...

|

|

|

20.04.2009, 22:10

|

|

Постоянный

Регистрация: 01.09.2007

Сообщений: 866

Провел на форуме:

2022674

Репутация:

1224

|

|

Код HTML:

http://forum.antichat.ru/thread90137.html

я думаю, и эта статья тебя заинтересует из той же серии |

|

|

30.06.2009, 13:28

|

|

Новичок

Регистрация: 19.10.2007

Сообщений: 18

Провел на форуме:

12326

Репутация:

10

|

|

Тест Тьюринга исследует только внешнее выражение человекоподобной разумности машины. За подробностями: http://ru.wikipedia.org/wiki/Китайская_комната

http://www.membrana.ru/themes/robots_and_ai/

http://www.eternalmind.ru/index.php?option=com_content&task=category§ion id=1&id=136&Itemid=2

|

|

|

22.07.2009, 21:48

|

|

Постоянный

Регистрация: 01.09.2007

Сообщений: 866

Провел на форуме:

2022674

Репутация:

1224

|

|

Сообщение от Чед

Тест Тьюринга исследует только внешнее выражение человекоподобной разумности машины.

да, но это основное с чего нужно начинать

|

|

|

|

|

|

|

Здесь присутствуют: 1 (пользователей: 0 , гостей: 1)

|

|

|

|

Линейный вид

Линейный вид